Das Uncanny Valley: Problem für Robotik und KI?

Warum menschenähnliche KI, Chatbots und digitale Agenten Unternehmen vor eine neue Kommunikationsfrage stellen.

NICOLAS SCHEIDTWEILER

Senior-Berater Organisationsentwicklung und Führung

T. +49 421 639 350 29

E. nicolas@scheidtweiler-strategie.com

Manchmal entstehen die interessantesten Gedanken nicht in Strategiepapieren, Innovationsprozessen oder auf den großen Bühnen der KI-Konferenzen.

Sondern in kurzen Gesprächen am Rand technologischer Entwicklungen. Dort, wo man plötzlich merkt, dass die eigentliche Fragestellung nicht technischer Natur ist. Sondern zutiefst menschlich.

Denn wie kennen ein Gefühl aus Filmen, wie „Chucky, die Mörderpuppe“, „A.I. – Künstliche Intelligenz“, „Friedhof der Kuscheltiere“, jüngst „M3GAN“.

Irgendwas stimmt nicht. Menschlich, aber nicht richtig menschlich.

Robotik und KI beeindrucken technologisch

Die Idee zu diesem Artikel entstand kürzlich im Austausch mit einem Robotikhersteller. Es ging um Bewegungsdynamik, Sensorik, KI-Integration, um Präzision und die nächste Evolutionsstufe intelligenter Systeme.

Und irgendwann fiel fast automatisch der Vergleich mit Boston Dynamics. Das Video illustriert die Entwicklung:

Technologisch beeindruckend. Ingenieurskunst auf höchstem Niveau. Maschinen, die laufen, springen, reagieren und sich beinahe organisch bewegen. Und trotzdem reagieren viele Menschen auf diese Systeme nicht nur mit Faszination, sondern zugleich mit einer subtilen Irritation. Manche empfinden sie sogar als latent bedrohlich.

Interessant daran ist weniger die Maschine selbst als unsere Reaktion darauf.

Denn irgendwo zwischen technischer Perfektion und sozialer Anschlussfähigkeit beginnt etwas zu kippen. Genau dort öffnet sich ein Konzept, das in Zeiten von KI, Chatbots und digitaler Kommunikation plötzlich enorme Aktualität besitzt: das sogenannte Uncanny Valley.

Das Uncanny Valley – eine Theorie über die feine Irritation

Der japanische Robotiker Masahiro Mori formulierte Anfang der 1970er Jahre eine Beobachtung, die heute fast prophetisch wirkt.

Seine These war ebenso simpel wie kontraintuitiv: Je menschenähnlicher Maschinen werden, desto stärker identifizieren wir uns zunächst mit ihnen. Bis zu einem bestimmten Punkt. Und dann kippt die Wahrnehmung.

Die Akzeptanz bricht ein.

Die Maschine wirkt plötzlich nicht mehr faszinierend, sondern unheimlich. Nicht mehr sympathisch, sondern irritierend. Erst wenn die Imitation nahezu perfekt ist, verlässt sie dieses Tal wieder.

Einordnung vorab:

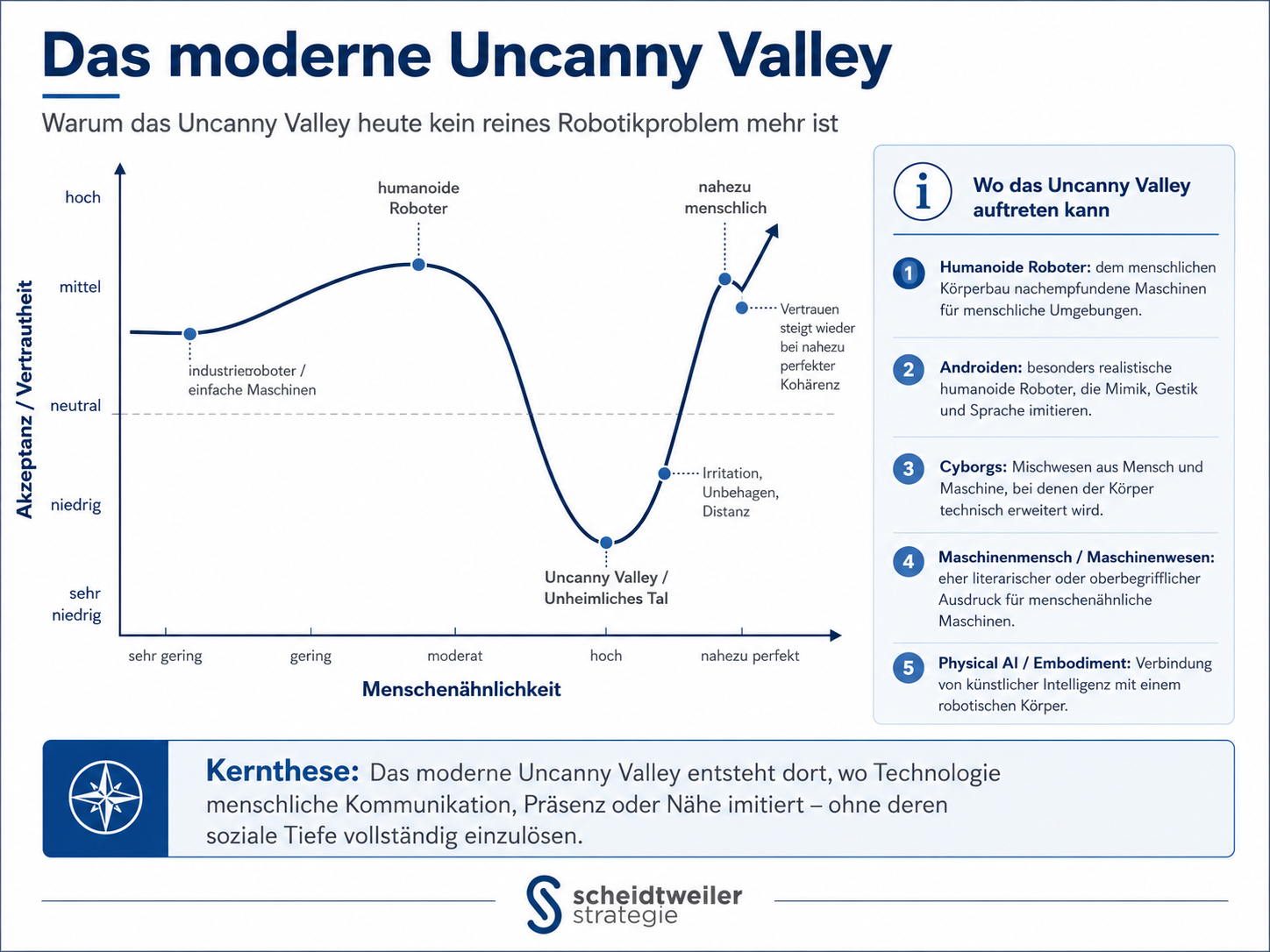

Wo das Uncanny Valley im Kontakt zwischen Mensch und Technologie entstehen kann

Das Uncanny Valley ist kein Phänomen einer einzelnen Technologie. Es entsteht überall dort, wo technische Systeme in die Nähe menschlicher Erscheinung, Bewegung, Kommunikation oder sozialer Präsenz rücken – ohne diese Nähe vollständig einzulösen.

Gerade deshalb lohnt eine begriffliche Präzisierung. Denn nicht jeder menschenähnliche Roboter ist ein Androide, nicht jede technische Erweiterung des Menschen ist Robotik, und nicht jede KI bleibt künftig im Bildschirm gefangen.

- Humanoide Roboter sind Maschinen, die dem menschlichen Körperbau nachempfunden sind: Kopf, Torso, Arme, Beine. Ihr Ziel ist vor allem funktional. Sie sollen sich in Umgebungen bewegen und Aufgaben übernehmen, die ursprünglich für Menschen gestaltet wurden. Das Uncanny Valley kann hier über Körperform, Proportion, Gangbild oder Bewegungslogik entstehen.

- Androiden sind eine speziellere Form humanoider Roboter. Sie sollen dem Menschen äußerlich möglichst realistisch ähneln und menschliches Verhalten imitieren: Mimik, Gestik, Sprache, Blickkontakt, Reaktionsmuster. Genau hier wird die Zone des Unheimlichen besonders sensibel, weil die Erwartung an soziale Stimmigkeit stark steigt.

- Cyborgs – kybernetische Organismen – beschreiben Mischformen aus biologischem Organismus und Maschine. Hier wird nicht die Maschine menschenähnlich, sondern der Mensch technisch erweitert: durch Prothesen, Implantate, Schnittstellen oder dauerhaft integrierte technische Komponenten. Das Uncanny Valley kann hier anders wirken, weil nicht nur die Maschine, sondern auch das Bild des Menschen selbst irritiert wird.

- Maschinenmensch oder Maschinenwesen sind ältere, eher literarische und kulturgeschichtliche Begriffe. Sie verweisen auf eine lange Tradition der Vorstellung künstlicher menschenähnlicher Wesen – von Mythologie über Science-Fiction bis zur modernen Robotik. Gerade diese kulturellen Bilder prägen bis heute, ob wir technische Menschennähe als faszinierend, hilfreich oder bedrohlich empfinden.

- Physical AI beziehungsweise präziser Embodied AI beschreibt die Verbindung von künstlicher Intelligenz mit einem physischen Körper. Die KI bleibt dann nicht mehr abstraktes System, Chatfenster oder Software-Agent, sondern bekommt räumliche Präsenz. Sie kann sich bewegen, handeln, reagieren und in menschlichen Umgebungen körperlich auftreten. Genau an diesem Übergang wird das moderne Uncanny Valley besonders relevant: Die Irritation entsteht nicht mehr nur durch Aussehen, sondern durch die Kombination aus Intelligenz, Körper, Sprache und sozialer Wirkung.

Entscheidend ist deshalb: Das Uncanny Valley beginnt nicht erst beim perfekten Menschenimitat. Es kann bereits dort entstehen, wo Technologie menschliche Nähe behauptet – über Körper, Stimme, Bewegung, Sprache oder simulierte Empathie –, diese Nähe aber nicht kohärent einlöst. Genau dort kippt Faszination in Distanz.

Nicht Fremdheit erzeugt Distanz – sondern fast überwundene Fremdheit

Das eigentlich Spannende daran: Menschen haben oft erstaunlich wenig Probleme mit klar erkennbarer Technologie. Ein klassischer Industrieroboter ist eindeutig Maschine. Ein Sprachcomputer ebenfalls. Schwieriger wird es dort, wo Systeme beginnen, sich in die menschliche Sphäre hineinzubewegen – ohne dort vollständig anzukommen.

Dann entsteht dieses schwer erklärbare Gefühl: Irgendetwas stimmt hier nicht ganz.

Vielleicht liegt genau darin eine fundamentale Eigenschaft menschlicher Wahrnehmung. Der Mensch reagiert hochsensibel auf minimale Inkonsistenzen in Sprache, Verhalten, Mimik oder sozialer Resonanz.

Das Unheimliche entsteht deshalb nicht durch Distanz zum Menschen. Sondern durch eine Nähe, die fast überzeugend wirkt – aber eben nur fast.

Die eigentliche Irritation ist psychologisch, nicht technologisch

Das Uncanny Valley wird häufig als Designproblem diskutiert. Tatsächlich berührt es jedoch Wahrnehmungspsychologie, Evolutionsbiologie, Kommunikationswissenschaft und letztlich sogar philosophische Fragen nach Echtheit und sozialer Kohärenz.

Der Mensch ist ein Resonanzwesen. Wir lesen permanent Mikroreaktionen: minimale Veränderungen in Stimme und Timing, soziale Anschlussfähigkeit, emotionale Kohärenz, subtile Widersprüche in Verhalten und Kommunikation.

Und genau deshalb reagieren wir empfindlich auf Systeme, die Nähe simulieren, ohne sie vollständig tragen zu können.

Die kleinen Brüche öffnen das Tal

Das erklärt auch, warum moderne KI-Systeme gleichzeitig faszinieren und irritieren.

Ein Chatbot formuliert plötzlich empathisch. Eine KI wirkt verständnisvoll. Fast menschlich. Und dann entsteht dieser kleine Bruch: eine unpassende Reaktion, fehlendes Kontextverständnis, eine merkwürdig glatte Formulierung, Emotionalität ohne emotionale Tiefe.

Es sind selten große Fehler. Sondern minimale Dissonanzen.

Aber gerade diese kleinen Irritationen öffnen das Tal.

Das neue Uncanny Valley ist kein Robotikproblem allein

Interessanterweise verschiebt sich das gesamte Phänomen derzeit weg von der klassischen Robotik.

Das eigentliche Uncanny Valley unserer Zeit entsteht nicht primär in humanoiden Bewegungen. Es entsteht in Kommunikation.

In Chatbots. In KI-Agenten. In automatisierten Bewerberdialogen. In synthetischer Empathie. In digitalen Assistenten, die beginnen, menschliche Interaktion zu imitieren.

Und genau deshalb wird das Thema plötzlich hochrelevant für Organisationen.

Denn dort, wo Unternehmen heute KI implementieren, geht es nicht mehr nur um Datenverarbeitung oder Prozessoptimierung. Es geht zunehmend um Beziehung.

Kommunikation ist mehr als Informationsübertragung

Viele Unternehmen diskutieren KI aktuell entlang klassischer Effizienzlogiken: schneller, skalierbarer, kostengünstiger, automatisierter.

Doch Kommunikation funktioniert nicht ausschließlich funktional. Kommunikation funktioniert über Vertrauen, Resonanz und soziale Kohärenz.

Gerade deshalb wird das Uncanny Valley im Kontext von Employer Branding, HR und Organisationskommunikation plötzlich strategisch relevant.

Warum das Personalwesen besonders sensibel reagiert

Im Personalwesen zeigt sich die Problematik fast exemplarisch.

Denn Recruiting, Onboarding oder Mitarbeiterkommunikation sind keine rein administrativen Prozesse. Sie sind identitätsbezogene Beziehungssituationen.

Menschen bewerten dort nicht nur Informationen. Sondern implizit auch Wertschätzung, Glaubwürdigkeit, kulturelle Passung und emotionale Sicherheit.

Wenn Organisationen in diesen Kontexten KI einsetzen, betreten sie deshalb keinen rein technologischen Raum. Sie intervenieren in soziale Wahrnehmungssysteme.

Menschen merken den Unterschied erstaunlich schnell

Ein sauber gebauter Chatbot kann Orientierung schaffen, Prozesse vereinfachen und Reaktionszeiten reduzieren. Absolut sinnvoll.

Problematisch wird es dort, wo Systeme beginnen, menschliche Nähe zu simulieren, ohne die soziale Komplexität tatsächlich tragen zu können.

Menschen spüren das häufig intuitiv. Vielleicht nicht immer rational erklärbar. Aber emotional.

Und genau deshalb entsteht Distanz oft nicht trotz technologischer Perfektion – sondern wegen ihrer fast perfekten Simulation.

Die gefährlichste Fehlannahme moderner KI-Projekte

Viele Unternehmen folgen aktuell implizit einer Vorstellung: Je menschlicher KI wirkt, desto erfolgreicher wird sie akzeptiert.

Ich halte das zunehmend für eine gefährliche Verkürzung.

Denn Menschen erwarten von Technologie nicht zwingend Menschlichkeit. Sie erwarten vor allem Klarheit, Verlässlichkeit, Transparenz und funktionale Ehrlichkeit.

Eine KI darf technisch sein. Sie darf begrenzt sein. Sie darf sogar distanziert wirken.

Kritisch wird es erst dort, wo Systeme soziale Fähigkeiten suggerieren, die sie strukturell nicht leisten können.

Das Problem ist inkonsistente Nähe

Das erklärt auch, warum manche überpersonalisierte KI-Kommunikation plötzlich manipulativ oder unangenehm wirkt.

Nicht weil sie schlecht gemacht wäre. Sondern weil sie emotional mehr verspricht, als sie einlösen kann.

Das Uncanny Valley ist letztlich die psychologische Reaktion auf inkonsistente Nähe.

Die eigentliche strategische Aufgabe für Unternehmen

Die entscheidende Kompetenz der nächsten Jahre wird deshalb vermutlich nicht darin liegen, möglichst menschliche KI zu entwickeln.

Sondern technologisch anschlussfähige Systeme mit sozialer Kohärenz zu gestalten.

Das ist ein fundamentaler Unterschied.

Organisationen werden lernen müssen, wann Automatisierung sinnvoll ist, wann menschliche Präsenz unverzichtbar bleibt, welche Kommunikationsräume KI sinnvoll unterstützen kann und wo Resonanz wichtiger bleibt als Effizienz.

Denn nicht jede Interaktion darf vollständig zum Prozess werden.

Hybride Gestaltung statt maximaler Automatisierung

Gerade in Employer Branding, Führung und Kulturarbeit entsteht Vertrauen oft in den kleinen Zwischenräumen menschlicher Kommunikation: in Ambivalenz, in spontaner Reaktion, in echter sozialer Präsenz, in emotionaler Anschlussfähigkeit.

Das lässt sich nicht beliebig simulieren.

Deshalb braucht es hybride Gestaltung: KI als Strukturhilfe, als Entlastung, als Vorarbeit, als Beschleuniger. Aber nicht als vollständigen Ersatz menschlicher Beziehungsmomente.

Das Uncanny Valley: Eine zutiefst menschliche Erinnerung

Je länger man sich mit dem Thema beschäftigt, desto stärker entsteht das Gefühl, dass das Uncanny Valley weit mehr ist als ein Robotikbegriff aus den 1970er Jahren.

Es erinnert uns daran, dass technologische Entwicklung nicht automatisch soziale Anschlussfähigkeit erzeugt.

Und vielleicht verweist es auf etwas noch Grundsätzlicheres: Dass der Mensch eben nicht nur ein informationsverarbeitendes System ist. Sondern ein Wesen, das auf Echtheit, Resonanz und Kohärenz reagiert.

Genau deshalb wird die Zukunft von KI vermutlich nicht dort entschieden, wo Systeme am menschenähnlichsten werden.

Sondern dort, wo Organisationen verstehen, wie Technologie sinnvoll in menschliche Beziehungssysteme eingebettet werden kann.

Nicht technische Perfektion entscheidet – sondern soziale Stimmigkeit

Weiterführende Quellen und Perspektiven

Grundlagen und Ursprung

Masahiro Mori: The Uncanny Valley

Psychologie und Wahrnehmung

Scientific American über die psychologische Wirkung humanoider Systeme

Empirische Forschung zum Uncanny Valley bei Frontiers in Psychology

Uncanny Valley: Warum uns KI das Fürchten lehrt

KI, UX und Conversational AI

Nielsen Norman Group zur Wahrnehmung von Chatbots

MIT Technology Review zu Vertrauen und KI-Interaktion

Human Centered, AI Powered – Wie wir User Experience in KI-Projekten optimieren

Bildrechte: Canva